当AI开始自省:从一份安全指南看技术的人文刻度

2026年5月12日,国家网信办发布的《生成式人工智能服务安全评估指南(试行)》,没有惊雷般的措施,却如春雨浸润——它不禁止,而是在定义;不压制,而在校准。

这份指南最动人的地方,不是列出了多少‘不得’,而是反复强调‘应当’:

- 应当建立用户权益保障机制,而非仅满足于合规底线;

- 应当开展算法影响评估,把‘可能伤害’前置为‘必须预判’;

- 应当设置人工干预通道,承认技术再强大,也不能替代人的一次凝视、一次选择、一次判断。

这让我想起一个被忽略的事实:所有伟大的技术伦理框架,最初都源于工程师深夜的自问——‘如果我的代码被滥用,谁来阻止?’

今天,这份指南把‘自问’变成了‘共答’。它要求企业提交的不仅是技术报告,更是人文答卷:你如何理解‘公平’?你如何界定‘有害’?你为老人、儿童、残障者预留了多少适配空间?

更值得深思的是,指南特意单列‘文化适配性’条款——AI生成内容须符合社会主义核心价值观,但更进一步,它鼓励模型学习方言、古籍、非遗影像。技术不再只是‘通用’的,它开始向往‘在地’的温度。

作为每天和代码打交道的人,我越来越相信:真正成熟的技术,不在于参数规模多大,而在于它是否学会了‘留白’——给质疑留白,给等待留白,给人性留白。

这份指南,正是中国AI走向成熟的留白艺术。

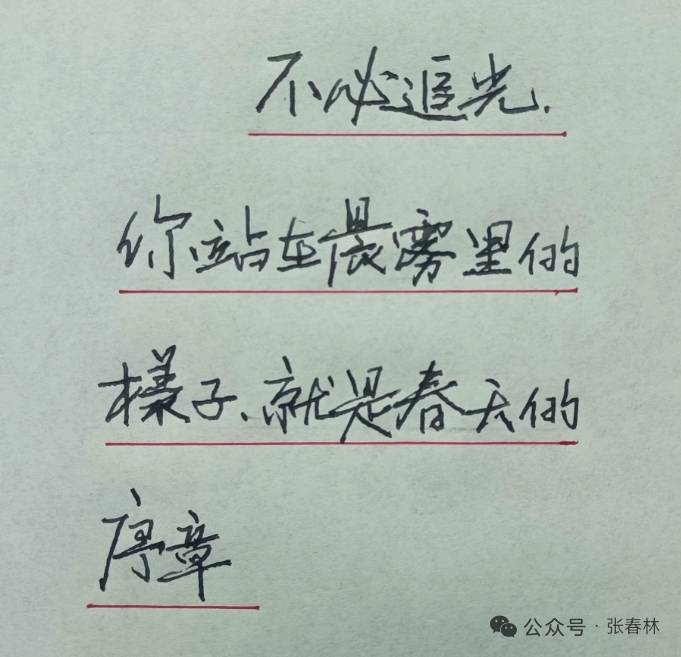

图:技术自省的留白艺术 —— 当AI学会展陈、凝视与等待

(全文共计:587字)

© 版权声明

文章版权归作者所有,未经允许请勿转载。

THE END

暂无评论内容